IEEE/CVF Conference on Computer Vision and Pattern Recognition(CVPR)是人工智能领域的顶级国际会议,CCF A类会议。CVPR 2026 将于2026年6月3日-6月7日在美国丹佛举办,共有16,092篇论文进入评审流程,最终4090篇被接收,录取率为25.42%。ASC实验室本次接收7篇主会论文、推荐3篇findings论文,主题涉及具身导航、协同感知、定位感知多任务、具身智能图灵测试、超快人体动作捕捉、激光雷达定位、步态识别等方向。

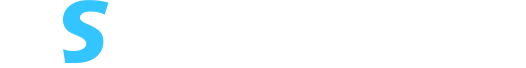

V2U4Real: A Real-world Large-scale Dataset for Vehicle-to-UAV Cooperative Perception

简介:自动驾驶感知系统通常受限于遮挡、盲区以及有限的感知范围。已有的车车协同和车路协同范式感知主体为地面视角,难以有效应对大规模遮挡与远距离感知需求。本文提出首个面向车与无人机协同目标感知的大规模多模态真实场景数据集V2U4Real。V2U4Real由搭载有激光雷达与RGB相机的地面车辆与无人机协同采集,采集场景覆盖城市街道、校园以及乡村道路等多种交通环境,共包含超过56K帧激光雷达数据、56K张多视角相机图像,涵盖四类目标的70万个三维标注框。此外,本文构建了单智能体三维目标检测、协同三维目标检测以及多目标跟踪等基准任务。对多种当前先进模型的评估结果表明,车与无人机协同感知可显著提升复杂场景感知鲁棒性与远距离感知能力。

该论文第一作者是硕士生李伟佳、硕士生项浩恩,通讯作者是温程璐教授。并由王天旭、吴帅兵、夏启明、王程教授共同合作完成。

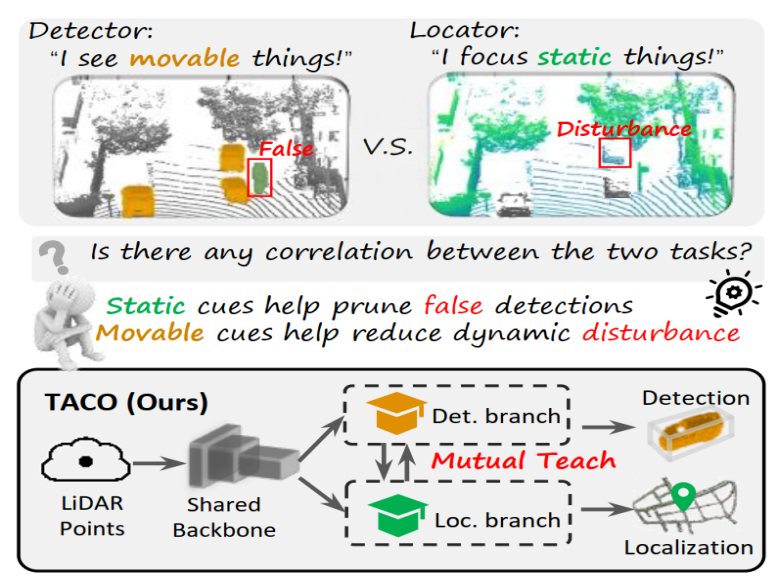

TACO: Task-Aware Contrastive Learning for Joint LiDAR Localization and 3D Object Detection

简介:自车定位和目标感知是自动驾驶车和智能机器人的关键任务。激光雷达视觉定位是对GNSS定位系统的有效补充手段。现有系统通常将定位与检测模型分离设计、分别优化,这导致计算冗余,也限制了跨任务知识迁移的潜力。此外,两项任务在语义关注与几何先验上存在差异,导致特征表示层面产生冲突,简单共享特征的多任务训练会导致性能下降。针对以上问题,本文提出了一种视觉定位和目标检测多任务学习框架TACO,通过对静态场景的几何结构特征与可移动目标的语义判别特征进行解耦,从而建立两个任务在同一框架下的协同关系。论文进一步构建了OxfoLD数据集以支撑训练与评估,实验结果表明,TACO在定位和检测性能上均有显著提升。

该论文第一作者是博士生邢乐园、硕士生张桓嘉,通讯作者是温程璐教授、王程教授。并由潘东屿,毕业生吴海(鹏城实验室),夏启明,熊恪峥,毕业生李文(布里斯托大学)共同合作完成。

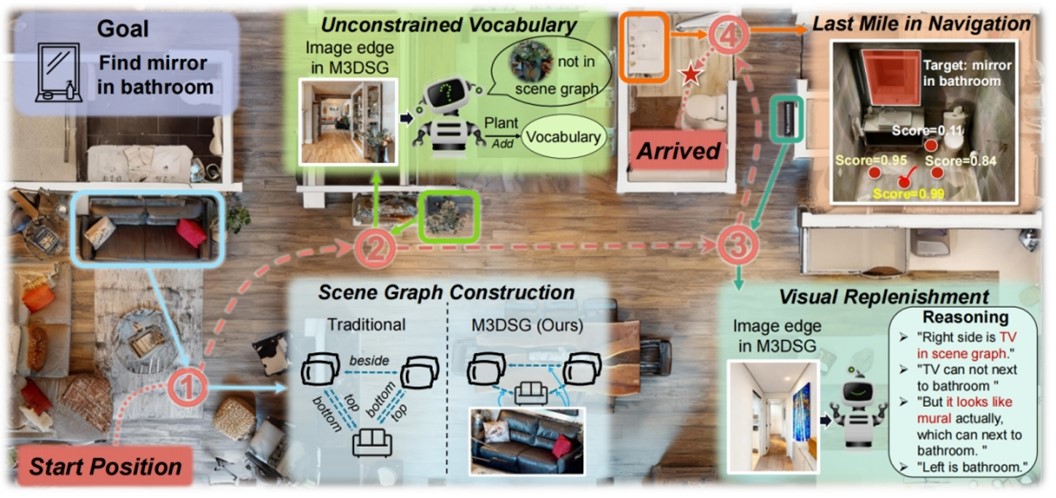

MSGNav: Unleashing the Power of Multi-modal 3D Scene Graph for Zero-Shot Embodied Navigation

该论文第一作者是博士生黄勋,通讯作者是温程璐教授、李伟欣副教授(北京航空航天大学)。并由赵世佳,张万发,王蕴红教授(北京航空航天大学)等共同合作完成。

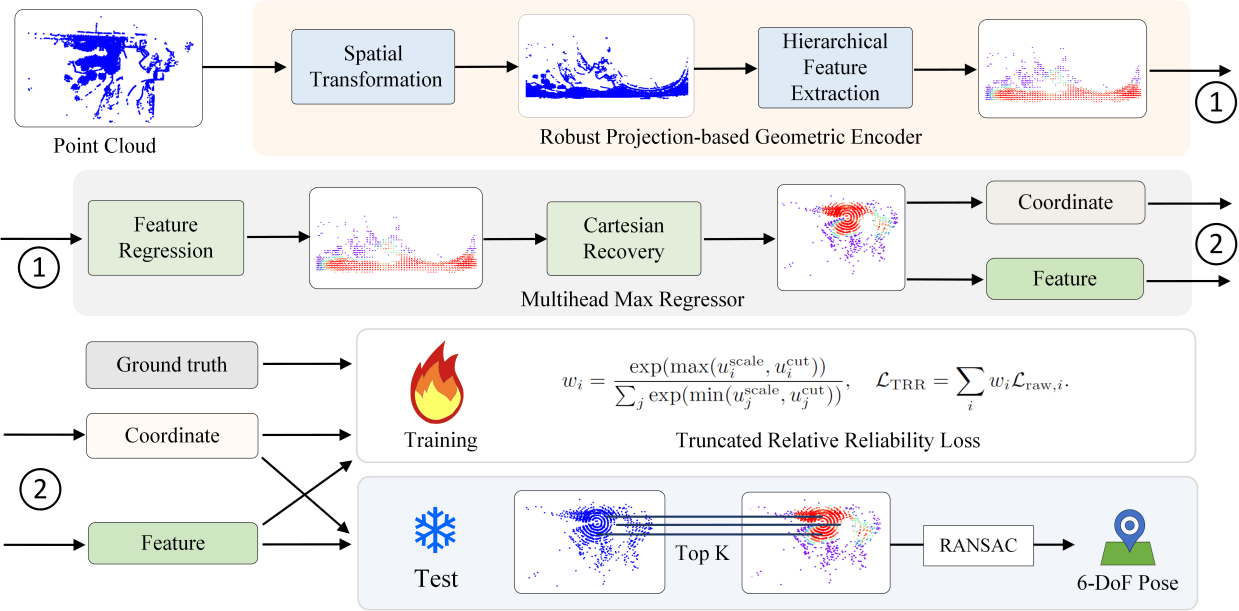

LEADER: Learning Reliable Local-to-Global Correspondences for LiDAR Relocalization

该论文第一作者是硕士生吴建实,通讯作者是敖晟助理教授。并由朱明航、刘敦强、毕业生李文(布里斯托大学)、沈思淇长聘副教授、温程璐教授、王程教授共同合作完成。

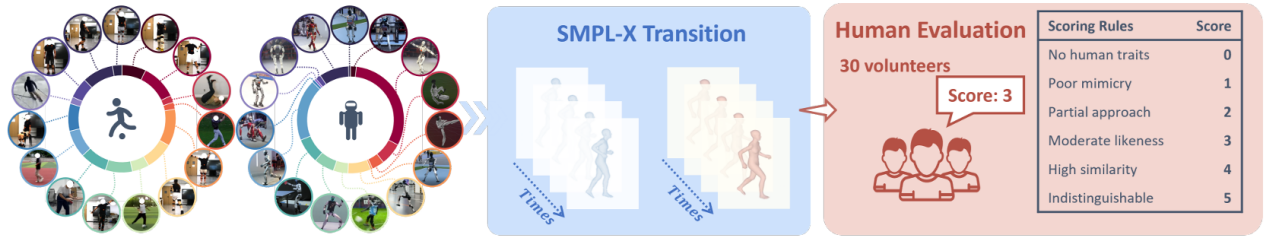

该论文第一作者是博士生李明哲、硕士生刘梦茵,通讯作者是沈思淇长聘副教授。并由吴泽凯、林心成、张俊圣、颜明、谢曾烨、张长旺(OPPO研究院)、温程璐教授、许岚助理教授(上海科技大学)、王程教授共同合作完成。

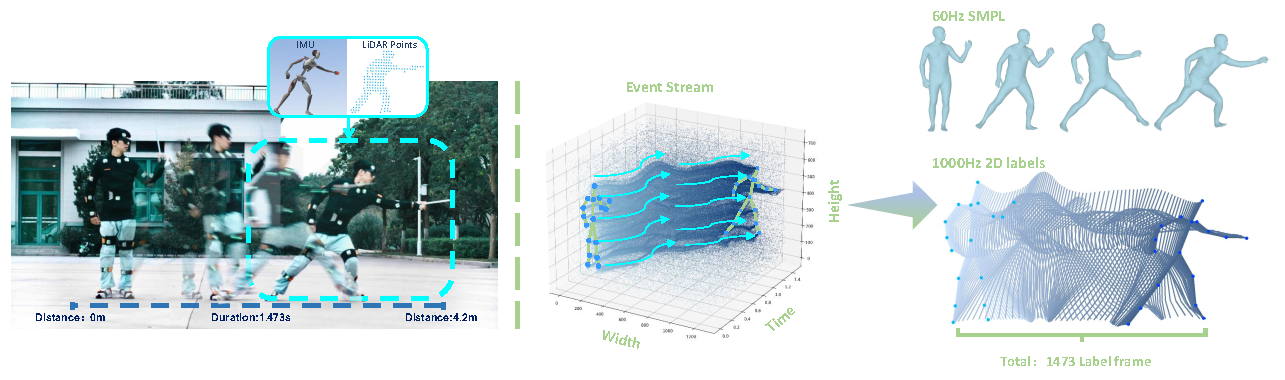

FlashCap: Millisecond-Accurate Human Motion Capture via Flashing LEDs and Event-Based Vision

该论文第一作者是硕士生吴泽凯、硕士生范书琪,通讯作者是沈思淇长聘副教授。并由刘梦茵、罗裕华、林心成、颜明、吴俊豪、毕业生林修弘、马月昕副教授(上海科技大学)、温程璐教授、许岚助理教授(上海科技大学)、王程教授共同合作完成。

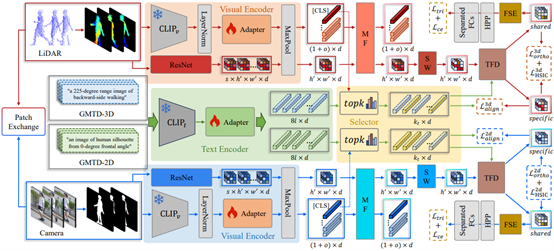

Text-guided Feature Disentanglement for Cross-modal Gait Recognition

该论文第一作者是博士生陆志阳,通讯作者是程明教授。