AAAI Conference on Artificial Intelligence会议是人工智能领域重要的国际会议,是CCF A类推荐会议。AAAI 2026将于2026年1月20日-27日在新加坡举办。今年共有23680篇论文投稿,最终4167篇论文接收,录用率17.6%。ASC实验共有8篇论文被AAAI 2026录用,涉及里程计、目标检测、协同感知、步态识别、事件相机和大模型微调等。录用论文简要介绍如下:

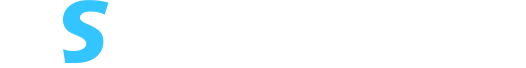

RCP-LO: A Relative Coordinate Prediction Framework for Generalizable Deep LiDAR Odometry

简介:基于学习的激光雷达里程计方法通过端到端回归相对位姿展现了优越性能,然而当迁移到新场景时性能显著降低。为此,本文提出一种简洁而高效的激光雷达里程计框架RCP-LO。首先,创新性地将相对位姿表示为相对坐标并基于几何验证进行求解,避免了过度简化的位姿表示。其次,为捕捉动态环境中遮挡点云相对位姿估计固有的不确定性,引入去噪扩散模型进行相对坐标采样,在增强鲁棒性的同时生成合理位姿假设。还设计了可微分加权奇异值分解模块,通过单次前向传播即可实现高效位姿估计。实验表明,仅在KITTI数据集上进行训练,在KITTI-360、Ford和Oxford数据集上均达到与当前最优学习方法相当的精度。

该论文第一作者是硕士生刘晨、博士毕业生李文,通讯作者是王程教授。并由黄泳树、朱明航、杨煜阳、刘敦强及敖晟助理教授共同完成。

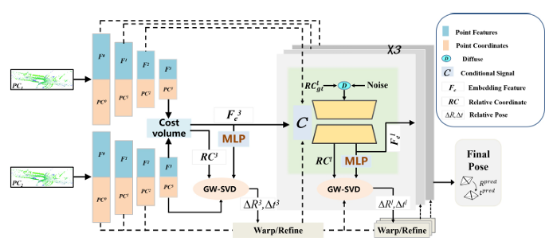

Physically-Based LiDAR Smoke Simulation for Robust 3D Object Detection

简介:在烟雾等恶劣天气下,激光雷达点云往往稀疏且噪声显著,导致三维目标检测性能严重下降。为此,本文提出了一种基于物理原理的烟雾仿真框架,用于合成高保真烟雾点云并增强模型感知鲁棒性。首先,构建了基于三维流体动力学的烟雾仿真系统,模拟烟雾粒子的空间扩散与时间演化;结合物理精确的激光雷达感知模块,捕捉光束衰减、散射与多路径效应等复杂光学交互,生成高保真、物理一致的烟雾点云。其次,使用基于距离图像的数据融合策略将仿真烟雾点云集成至真实LiDAR数据集,准确模拟LiDAR扫描特性并自然引入遮挡效应。此外,构建了真实场景LiDAR烟雾数据集LiSmoke用于方法性能验证。结果表明,使用本方法合成数据训练的模型在烟雾场景中检测性能显著提升。

该论文第一作者是博士生郑世均,通讯作者是王程教授、刘伟权副教授(集美大学)。并由郭宇、臧彧副教授、沈思淇长聘副教授、程明教授共同合作完成。

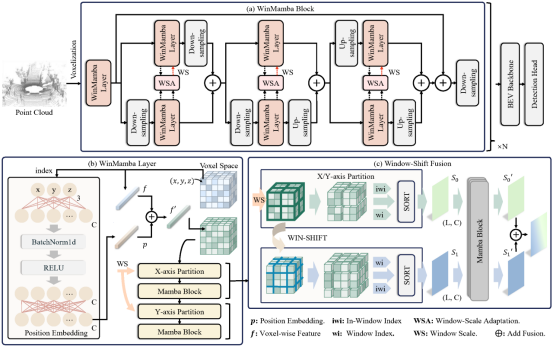

WinMamba: Multi-Scale Shifted Windows in State Space Model for 3D Object Detection

简介:三维目标检测是自动驾驶感知的重要任务,但在最大化计算效率和捕捉长距离空间依赖关系方面仍存在挑战。Mamba模型凭其线性状态空间设计,能以更低的计算成本捕捉长距离依赖,从而在效率与精度间取得良好平衡。然而,现有方法依赖固定窗口内的轴对齐扫描,不可避免地丢失部分空间信息。为此,本文提出基于Mamba的三维特征编码主干网络WinMamba。首先,为增强主干网络的多尺度表征能力,引入了一个窗口尺度自适应模块,在采样过程中对不同分辨率下的体素特征进行补偿。其次,为了在线性状态空间中获取丰富的上下文线索,引入了可学习的位置编码和窗口移位策略。在KITTI和Waymo数据集上的实验表明提出的方法显著优于基线方法。

该论文第一作者是硕士生郑龙辉、博士生夏启明,通讯作者是温程璐教授。并由陈晓璐、刘昭亮、王程教授共同合作完成。

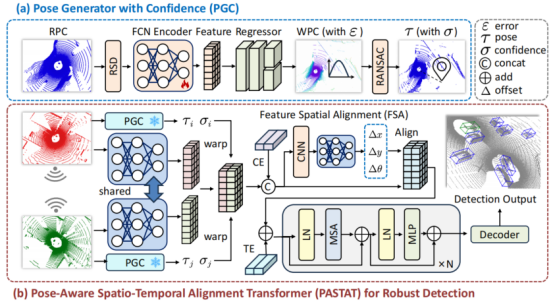

V2VLoc: Robust GNSS-Free Collaborative Perception via LiDAR Localization

简介:多智能体依赖于精确的姿态信息共享和对齐观测数据,以实现对环境的协同感知。然而,现有定位方法在GNSS信号受限环境下容易失效,导致难以实现一致的感知特征对齐。为此,本文提出一种基于激光雷达定位的无GNSS协同目标感知框架。首先提出了轻量级的置信度姿态生成器估计紧凑的姿态和置信度表示,其次设计了姿态感知时空对齐变换器,在捕获关键时间上下文的同时,执行置信度感知的空间对齐。此外,提出一个新的仿真数据集V2VLoc,用于验证定位和协同检测任务。在 V2VLoc和V2V4Real 数据集上的实验验证了本方法的有效性和泛化能力。

该论文第一作者是硕士生林文铠,通讯作者是温程璐教授。并由夏启明、李文、黄勋共同合作完成。

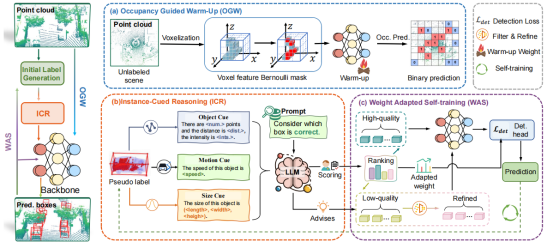

OWL: Unsupervised 3D Object Detection by Occupancy Guided Warm-up and Large Model Priors Reasoning

简介:无监督三维目标检测通过启发式算法发现潜在目标,为自动驾驶降低标注成本提供了有效途径。现有方法主要通过生成伪标签并进行自训练迭代来优化模型,但这些伪标签在训练初期往往存在错误。为此,本文提出基于占用引导预热和大模型先验推理的无监督目标检测方法OWL。首先采用占用引导的自监督预热策略学习场景特征,有效缓解错误伪标签对网络收敛的干扰;其次引入实例线索推理模块,利用大模型先验知识评估与优化伪标签质量;最后设计自适应权重自训练策略提升模型性能。在Waymo和 KITTI 数据集上的实验表明OWL显著优于SOTA无监督方法。

该论文第一作者是硕士生郭徐晟,通讯作者是温程璐教授、博士毕业生吴海助理研究员(鹏城实验室)。并由张万发、赵世佳、夏启明、王明明(GAC R&D Center)共同合作完成。

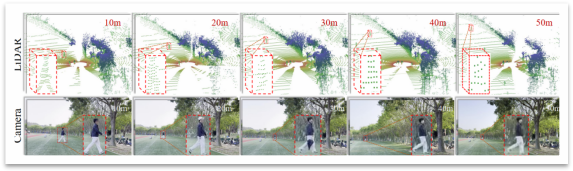

Walking Further: Semantic-aware Multimodal Gait Recognition under Long-Range Conditions

简介:步态识别能通过人的行走方式实现非接触、难伪造的身份识别。然而,现有的方法仍局限于近距离、单模态场景,在复杂的真实环境中难以适应远距离或跨距离识别需求。为解决这一问题,本文提出首个面向远距离、室外多场景的LiDAR-相机多模态步态识别基准数据集LRGait。此外,本文设计一个全新的端到端框架EMGaitNet,专为远距离多模态步态识别而优化,通过语义引导的多模态融合策略,有效弥合了RGB图像与点云数据之间的模态差距。

该论文第一作者是博士生陆志阳,通讯作者是程明教授。并由江文、吴天任、王志超、沈思淇长聘副教授、张长旺高级研究员(OPPO研究院)共同合作完成。

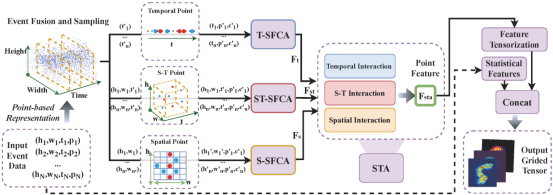

OmniEvent: Unified Event Representation Learning OmniEvent

简介:事件相机因其超高的动态范围和时间分辨率,在计算机视觉领域日益受到关注。然而,由于事件数据流的非结构化分布和时空非均匀性,现有方法主要依赖特定任务的设计,导致模型难以在不同任务间复用。为此,本文提出了首个统一的事件表示学习框架OmniEvent,旨在消除对特定任务设计的需求。OmniEvent在空间域和时间域上独立进行局部特征聚合与增强,以避免时空不均的问题。此外,采用空间填充曲线以极高的内存和计算效率实现大感受野,并最终通过注意力机制融合时空特征。在3个代表性任务和10个数据集上均取得了SOTA性能。

该论文第一作者是博士生严伟奇、硕士生林晨露,通讯作者是臧彧副教授、蔡志鹏研究员(Meta AI)。并由汪有标、林修弘、施阳阳研究员(Meta AI)、刘伟权副教授(集美大学)共同合作完成。

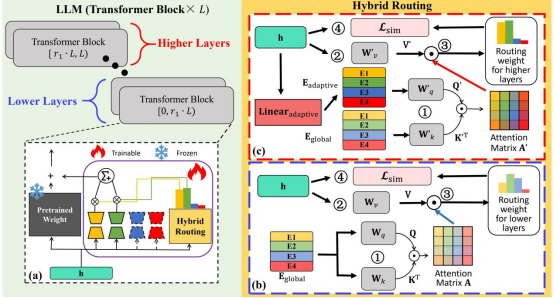

Hybrid Routing for a Mixture of LoRA Experts

简介:本文提出了一种名为HotMoE 的异构路由混合LoRA专家模型框架,旨在解决多任务指令微调中专家利用效率低和专家与任务适配不足的问题。HotMoE 引入分层混合路由机制,在浅层促进跨任务协作与泛化,在深层实现任务语义与专家能力的精确对齐。此外,提出相似度引导的辅助损失,增强专家专化性与路由确定性。实验结果表明,HotMoE 在多个自然语言理解与大模型生成任务上显著优于现有多任务微调方法,有效缓解了多任务学习中的“跷跷板效应”。

该论文第一作者是硕士生黄逸桐,通讯作者是范晓亮高级工程师。并由杨子棋、王子徽(鹏城实验室)、Jianzhong Qi (墨尔本大学)、俞容山教授、王程教授共同合作完成。